Le département américain de la Défense vient de franchir un cap que beaucoup jugeaient encore prématuré. Google et le Pentagone ont conclu un accord permettant de déployer Gemini, le grand modèle de langage de la firme de Mountain View, dans des environnements classifiés. Des systèmes d’information protégés, des réseaux isolés, des données que les civils ne verront jamais.

Ce n’est pas une expérimentation de laboratoire. C’est une intégration opérationnelle.

Google entre dans les réseaux classifiés du Pentagone

L’accord porte sur une version adaptée de Gemini, conçue pour fonctionner dans les infrastructures sécurisées du ministère américain de la Défense. Ces environnements dits “air-gapped” sont physiquement déconnectés d’internet. Y faire tourner un LLM commercial représente un défi technique et politique considérable.

Le timing n’est pas anodin. L’administration Trump a affiché dès son retour à la Maison-Blanche une volonté de muscler l’usage de l’IA dans l’appareil militaire. Le budget de défense américain pour 2025 prévoit plusieurs milliards de dollars fléchés vers la modernisation technologique des forces armées. L’IA en est le centre de gravité.

Pour Google, ce contrat efface en partie le souvenir douloureux de Project Maven en 2018, quand des milliers d’employés avaient contraint la direction à abandonner un contrat de vision par ordinateur avec l’armée. Sept ans plus tard, l’entreprise revient, avec moins d’état d’âme interne et un modèle autrement plus puissant.

Ce que signifie confier une IA générative à des militaires

Déployer un modèle génératif dans un cadre classifié soulève des questions que les benchmarks académiques ne couvrent pas. Hallucinations dans un rapport de renseignement. Biais dans l’analyse de données adverses. Confiance accordée à une sortie de modèle sans possibilité de vérification externe. Les risques ne sont pas théoriques.

Le Pentagone n’est pas novice. Il utilise depuis plusieurs années des outils d’IA pour la reconnaissance d’images satellitaires, la logistique ou la maintenance prédictive. Mais les modèles de langage génératifs opèrent différemment. Ils produisent du texte, synthétisent des documents, rédigent des analyses. Ils peuvent influencer la décision humaine d’une façon que les algorithmes de classification classiques ne permettaient pas.

C’est précisément là que certains analystes tirent la sonnette d’alarme. Dans les cercles de réflexion sur la sécurité nationale à Washington, on parle de “automation bias” : la tendance humaine à faire confiance à une sortie automatisée, surtout quand elle est formulée avec la fluidité d’un rapport professionnel. Tony Stark avait au moins le bon sens de se méfier de ses propres systèmes.

L’enjeu géopolitique est explicite. La Chine investit massivement dans l’IA militaire, et Pékin ne se pose pas les mêmes questions éthiques que les démocraties occidentales, ou du moins ne les pose pas au même moment. La course est lancée, et le Pentagone a choisi de ne pas attendre que les garde-fous soient parfaits.

Ce que ce déploiement change pour l’industrie tech

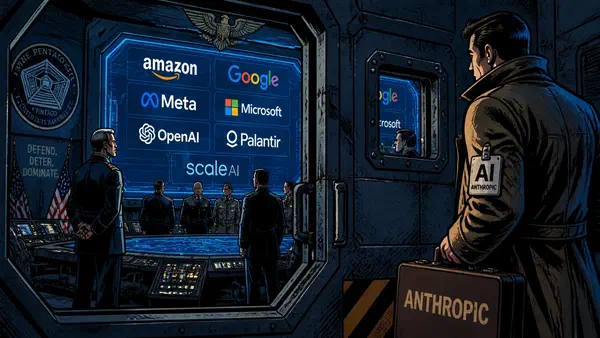

Pour les grandes entreprises technologiques américaines, ce contrat envoie un signal. Microsoft avait ouvert la voie avec Azure Government et ses déclinaisons classifiées, hébergeant des services OpenAI pour des agences fédérales. Google comble son retard sur ce segment.

Le marché de l’IA pour la défense et le renseignement américains est estimé à plusieurs dizaines de milliards de dollars sur la prochaine décennie. Ce n’est plus un marché de niche. C’est une priorité stratégique pour quiconque veut peser dans l’écosystème IA à long terme.

En Europe, ce mouvement aura des répercussions. La question de la souveraineté numérique, déjà tendue autour des données de santé ou des infrastructures critiques, prend une nouvelle dimension quand on voit les géants américains s’installer au cœur des appareils militaires alliés. Les armées européennes, dont la française, vont devoir choisir : développer leurs propres capacités ou s’aligner sur des outils dont elles ne maîtrisent pas la conception.

Un choix que personne ne veut formuler à voix haute, mais que les contrats signés à Washington rendent chaque jour plus urgent.

La question n’est pas de savoir si Gemini peut analyser des données classifiées, mais qui sera responsable quand son analyse sera fausse ?