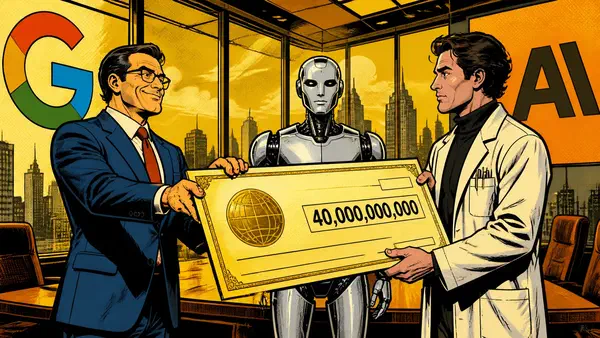

Sept entreprises. Une absente. Le Département de la Défense américain a accordé des accords d’accès prioritaire à des systèmes d’intelligence artificielle à Amazon, Google, Meta, Microsoft, OpenAI, Palantir et Scale AI. Anthropic, la startup fondée par d’anciens d’OpenAI et connue pour son modèle Claude, n’a pas été retenue.

Ce choix intervient dans un contexte de militarisation accélérée de l’IA. Washington veut intégrer ces technologies dans ses opérations d’analyse, de renseignement et de logistique. Vite. La Chine n’attend pas.

Sept entreprises dans le périmètre de confiance du Pentagone

Les accords signés permettent aux équipes du DoD d’accéder aux modèles et infrastructures de ces fournisseurs sélectionnés. Il ne s’agit pas d’un contrat unique mais d’une structure de partenariat qui encadre l’expérimentation et le déploiement de l’IA dans les opérations militaires américaines.

Parmi les élus, on retrouve les suspects habituels des marchés publics technologiques. Amazon Web Services et Microsoft Azure dominent déjà l’infrastructure cloud de la défense. Google a bataillé pendant des années pour rentrer dans ce périmètre, après avoir abandonné le projet Maven en 2018 sous pression de ses propres employés. OpenAI, longtemps présenté comme une organisation à but non lucratif soucieuse de l’humanité, est désormais un fournisseur régulier du complexe militaro-numérique américain. Palantir et Scale AI, elles, n’ont jamais caché leurs ambitions dans ce secteur.

Sept entreprises acceptées, donc. Et une qui se distingue par son absence.

L’exclusion d’Anthropic, entre lecture politique et lecture commerciale

Anthropic aurait pu figurer sur cette liste. Ses modèles Claude rivalisent techniquement avec GPT-4o ou Gemini. La startup a levé plusieurs milliards de dollars, notamment auprès d’Amazon, qui figure dans la liste des partenaires retenus. La relation est indirecte mais bien réelle.

Pourquoi cette mise à l’écart ? Deux lectures coexistent. La première est commerciale : Anthropic ne dispose pas de la même infrastructure de déploiement à grande échelle que ses concurrents. Vendre un modèle est une chose, opérer pour un client comme le Pentagone en est une autre. La deuxième lecture est politique. Anthropic a bâti son identité sur la “sécurité de l’IA”, comprendre : la prudence avant la puissance. Cette posture, séduisante en Europe et dans les cercles académiques, est moins bien reçue dans un ministère de la défense qui cherche des capacités opérationnelles, pas des garde-fous philosophiques.

Daredevil ne refuse pas une mission parce qu’il a peur de tomber. Il calcule la chute et saute quand même. Ce positionnement “safety-first” a peut-être coûté cher à Anthropic dans les couloirs de la défense américaine. Ou peut-être que la startup n’a tout simplement pas sollicité ces contrats, fidèle à une ligne éthique qui lui interdit de servir certains usages militaires.

Ce que ça change pour l’écosystème IA

Pour les entreprises retenues, ces accords représentent plus qu’un revenu : c’est une validation institutionnelle. Le Pentagone devient un client de référence, ce qui pèse dans les appels d’offres suivants, publics comme privés. L’expérience acquise dans ces environnements à contraintes élevées se convertira en avantage compétitif durable.

Pour Anthropic, l’exclusion crée une asymétrie commerciale qui risque de s’aggraver. Ses concurrents accumulent de l’expérience opérationnelle dans les contextes les plus exigeants qui soient. Claude, lui, reste hors du terrain d’entraînement. Pour les marchés européens et français, la leçon est plus large. Si l’IA présentée comme “sûre” perd des parts de marché face à l’IA rapide et flexible, les régulateurs du Vieux Continent devront choisir : protéger un modèle de développement vertueux, ou accepter de rater le train.

Et si la vraie question n’était pas de savoir quelle IA est la plus sûre, mais quelle définition de “sûr” impose désormais celui qui signe les chèques ?